В какой-то момент мне стало интересно, насколько вообще далеко зашла история с локальными LLM на смартфонах. Не в теории, не в духе «вот когда-нибудь мобильные чипы догонят настольные машины», а прямо сейчас. Поэтому я поставил PocketPal на свой Huawei Pura 70, скачал несколько моделей и решил посмотреть, можно ли этим реально пользоваться в повседневной жизни.

Сразу скажу честно: это не история про то, что телефон внезапно заменил ChatGPT, рабочий ноутбук и все остальные инструменты разом. Но это уже и не игрушка на пять минут, которую запускаешь ради галочки и потом забываешь. Для коротких вопросов, черновиков, быстрых подсказок по коду, бытовых задач и просто локального помощника под рукой такая схема у меня оказалась вполне рабочей.

Что такое PocketPal и зачем вообще запускать LLM на телефоне

PocketPal это приложение для локального запуска языковых моделей прямо на смартфоне. Вся идея в том, что модель работает на устройстве, а не на внешнем сервере. Для меня это как раз и было главным интересом. Иногда хочется иметь под рукой инструмент, который не зависит от облака, доступа к сервису, VPN, лимитов или просто от качества связи.

В этом есть и вполне практический смысл. Открываешь приложение, задаешь вопрос, получаешь ответ и не думаешь каждый раз, куда ушел твой запрос и когда сервер на другой стороне решит, что сегодня он занят чем-то более важным. Для мелких рабочих и бытовых задач такой формат выглядит очень привлекательно.

На чем я это запускал

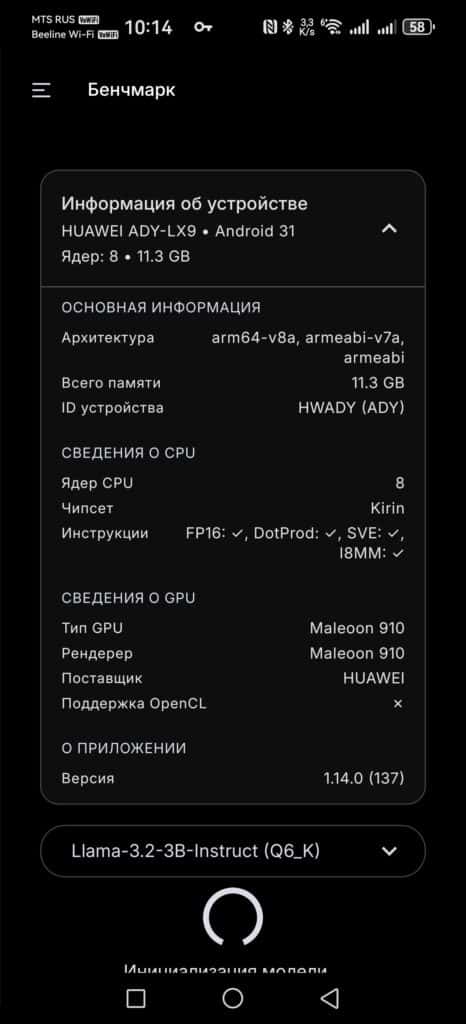

Тестировал я все это на Huawei Pura 70. По встроенному бенчмарку PocketPal приложение определило устройство как HUAWEI ADY-LX9 на Android 31. В информации о железе у меня отобразились 8 ядер CPU, 11.3 ГБ доступной памяти, чипсет Kirin и GPU Maleoon 910.

Там же было видно, что доступны инструкции FP16, DotProd, SVE и i8MM, а вот OpenCL не поддерживается. Для меня это был интересный момент, потому что даже без красивой истории про универсальное GPU-ускорение приложение на таком железе все равно оказалось живым и пригодным для практики.

Как я ставил PocketPal

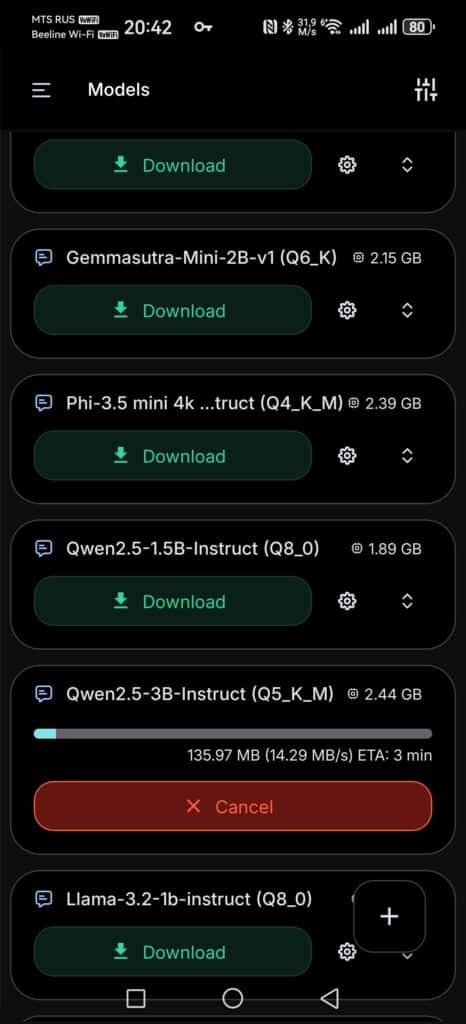

С установкой все довольно просто. Я поставил приложение, открыл раздел моделей, посмотрел, что доступно для загрузки, и начал выбирать, что именно попробовать. После скачивания модель появляется в списке Ready to Use, дальше ее можно загрузить в память и открыть отдельный чат.

На моих скриншотах как раз виден весь этот путь. Сначала каталог моделей с кнопками Download, потом загруженная модель в списке готовых к использованию, потом уже экран чата и отдельный экран бенчмарка. То есть это не история уровня «собери все из консоли и молись, чтобы запустилось». Для обычного Android-пользователя старт здесь вполне человеческий.

Какие модели я попробовал

В каталоге у меня были видны Gemma-2-2b-it, Gemmasutra-Mini-2B-v1, Phi-3.5 mini 4k instruct, Qwen2.5-1.5B-Instruct, Qwen2.5-3B-Instruct и Llama-3.2-1b-instruct. В итоге я скачал Qwen2.5-3B-Instruct в квантизации Q5_K_M, размером 2.44 ГБ.

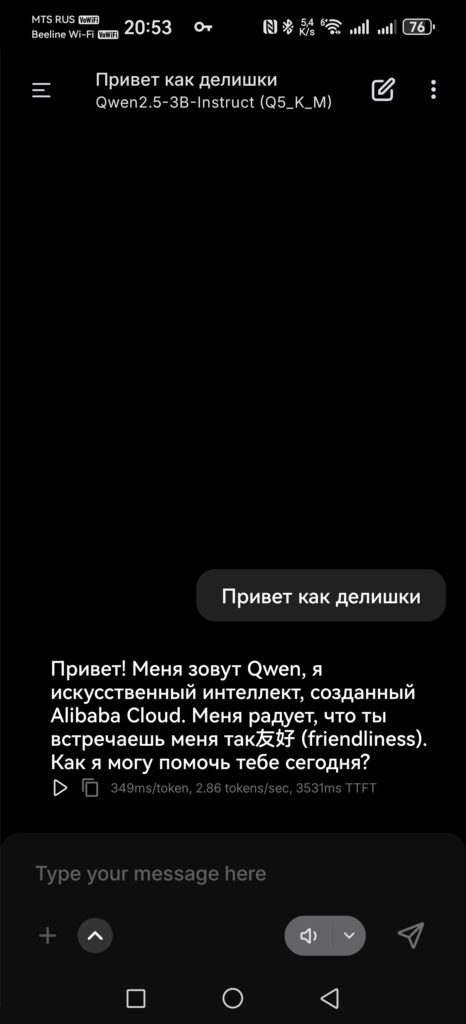

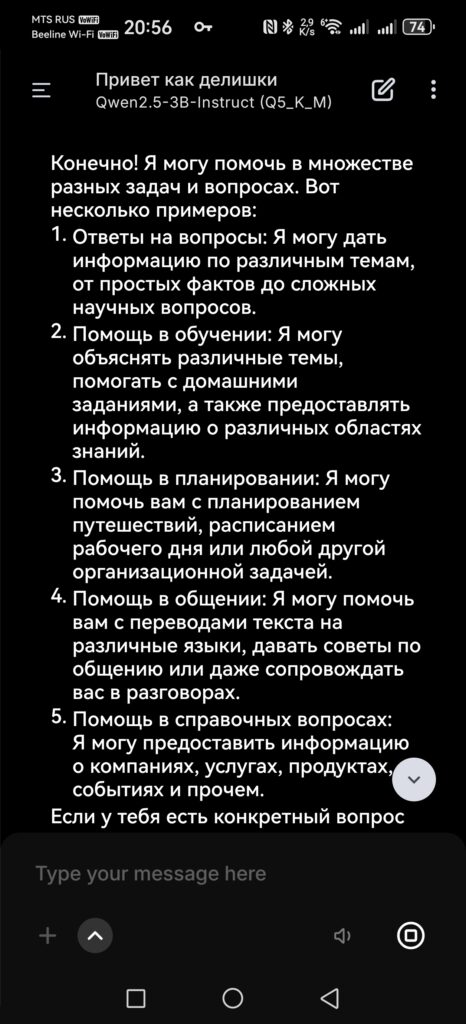

Почему начал именно с Qwen. Потому что это выглядит как нормальный компромисс между размером модели и ее практической пользой. Она уже не совсем крошечная, но при этом еще не выглядит чем-то запредельным для телефона. На моих скриншотах Qwen спокойно отвечала на русском и даже выдала пример с CSS для WordPress. Для локальной 3B-модели, которая работает прямо на смартфоне, это уже вполне достойно.

Отдельно мне понравилось, что телефон явно готов и к другим экспериментам. На экране бенчмарка у меня была выбрана Llama-3.2-3B-Instruct в квантизации Q6_K. То есть речь уже идет не о том, что устройство тянет только совсем легкие модели для галочки. 3B-класс здесь выглядит вполне реальной зоной для личных тестов.

Что показал бенчмарк

Новый скриншот с бенчмарком добавил в статью как раз потому, что он дал больше конкретики. Когда просто открываешь чат и видишь ответы, это уже интересно. Но когда сверху появляется еще и нормальная техническая фактура, картина становится куда понятнее.

Теперь уже видно не только то, что приложение запустилось, но и на чем именно оно работает, сколько памяти видит, какие инструкции у процессора доступны, какой GPU определился, и что у меня в руках не просто «какой-то современный телефон», а вполне конкретная мобильная платформа, на которой локальный AI уже можно трогать без скидки на волшебство.

Как это ощущается в реальной работе

Самое приятное впечатление у меня было от того, что все это не выглядело мертвым или декоративным. На одном из скриншотов уже виден живой чат с моделью и служебные метрики генерации: примерно 349 мс на токен, около 2.86 токена в секунду и TTFT порядка 3531 мс.

Нет, это не ураганная скорость. Но для телефона и локальной модели это уже вполне рабочий ритм, а не бессмысленная пытка ожиданием. Если мне нужен короткий ответ, быстрый черновик, пересказ, бытовая подсказка или мелкая помощь по коду, такой сценарий вполне годится.

Если же ждать от смартфона качества и скорости хорошего облачного сервиса, тогда разочарование приходит быстро. И это нормально. Телефон тут не должен выигрывать гонку у больших моделей на серверном железе. Его задача другая: быть автономным карманным инструментом для простых и средних задач.

Что мне понравилось

Во-первых, сам PocketPal оказался понятнее, чем я ожидал. Интерфейс с моделями, загрузкой, чатом и бенчмарком не выглядит программой только для людей, которые общаются с gguf-файлами на уровне духовной близости.

Во-вторых, на Huawei Pura 70 вся эта история уже выглядит не как красивая демонстрация, а как нормальный рабочий сценарий. Телефон не превращается в кирпич сразу после запуска, модель отвечает, а локальный AI перестает быть только презентационной игрушкой.

В-третьих, мне понравилась сама идея автономности. Можно использовать телефон как карманный AI-блокнот, как офлайн-помощник или просто как площадку для тестов разных моделей. Для человека, которому интересны Linux, WordPress, мобильные эксперименты и вообще всякая прикладная техно-жизнь, это реально приятная штука.

Где ограничения и почему телефон все-таки не сервер

Тут все довольно честно. Даже если 3B-модель на телефоне уже работает, это не значит, что можно безнаказанно качать все подряд и ждать чуда. Память, скорость, нагрев и размер моделей никуда не деваются. Те же 2.44 ГБ на один Qwen уже неплохо так кусают хранилище. А если начать собирать маленький мобильный зоопарк из нескольких моделей, телефон быстро напомнит, что место и ресурсы у него не бесконечные.

Второй момент это ожидания от качества. Локальная модель на смартфоне хороша как помощник для коротких задач, но не как абсолютная замена облачным флагманам. Сложный код, длинный контекст, тяжелая логика и большие тексты все еще удобнее гонять на более мощном железе или в хорошем облаке.

Третий момент это банальный форм-фактор. Даже если модель отвечает вполне прилично, длинный рабочий диалог, детальная редактура и большие куски кода на телефоне остаются не самым удобным занятием просто потому, что экран маленький, а пальцы большие. Иногда проблема уже не в модели, а в самом мобильном формате.

С чего бы я советовал начинать

Если хочется просто понять, жив ли вообще локальный AI на смартфоне, я бы начал с моделей 1B или 1.5B. Это легче, быстрее и безопаснее для нервной системы устройства.

Если хочется уже не просто сказать «ну да, оно открывается», а получить что-то реально полезное, то 2B и 3B на хорошем смартфоне выглядят интереснее. В моем случае именно Qwen2.5-3B-Instruct показал тот уровень, где локальная модель уже не просто существует, а действительно может приносить практическую пользу.

А вот начинать с тяжелых вариантов я бы не советовал. Тут лучше без героизма. Телефон все-таки должен еще жить обычной жизнью, а не тянуть на себе чужие фантазии про карманный дата-центр.

Итог

Эксперимент с PocketPal на Huawei Pura 70 у меня скорее удался. Я не получил магию уровня больших облачных сервисов, но получил вполне рабочий локальный AI-сценарий прямо в телефоне. Для коротких задач, подсказок, черновиков, быстрых формулировок и просто любопытства этого уже достаточно, чтобы история выглядела не игрушкой, а реальным инструментом.

После нового скриншота бенчмарка картина стала еще интереснее. Теперь видно не просто «ну вроде запускается», а более понятный технический контекст: сколько памяти видит приложение, какой GPU определился, какие инструкции доступны и какая модель выбрана для теста. Это хорошо дополняет мои практические впечатления.

Если давно хотелось попробовать локальные LLM на телефоне, но не было желания превращать это в техно-экспедицию с плясками вокруг терминала, PocketPal выглядит как хороший старт. А если у вас смартфон уровня Huawei Pura 70, то это уже не история из серии «может быть когда-нибудь». Это можно запустить прямо сейчас и посмотреть своими глазами.