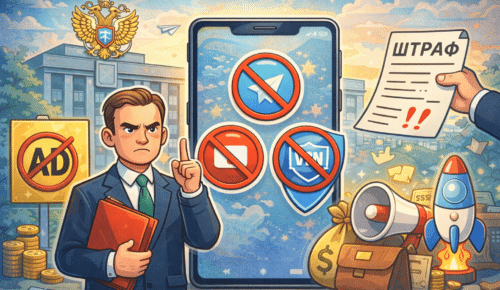

Тема важная и нервная. Особенно на фоне заголовков в духе «иностранный ИИ скоро запретят». Когда начинаешь читать не пересказы, а сам проект и то, как его описывает РБК, картина получается не такой лобовой, но и не безобидной.

Если коротко, прямо сейчас речь не идет о мгновенном полном запрете ChatGPT, Claude, Gemini и всего зарубежного ИИ для всех пользователей и компаний. Но новый законопроект очень явно закладывает базу под другой сценарий. Государственный сектор, критическая инфраструктура и все, что связано с чувствительными данными, постепенно будут подталкивать к использованию доверенных и по сути локализованных моделей. А дальше уже все будет зависеть от того, насколько широко государство начнет раскручивать этот механизм.

Основная статья РБК по теме здесь: Власти представили законопроект о регулировании ИИ.

Сам проект, вынесенный на общественное обсуждение, опубликован на федеральном портале: проект на regulation.gov.ru.

Что вообще предлагает новый законопроект

По сути это рамочный закон об ИИ. Он впервые пытается собрать в одну конструкцию базовые определения, права и обязанности участников рынка, маркировку сгенерированного контента, правила для моделей, требования к безопасности и подход к использованию ИИ в государственном контуре.

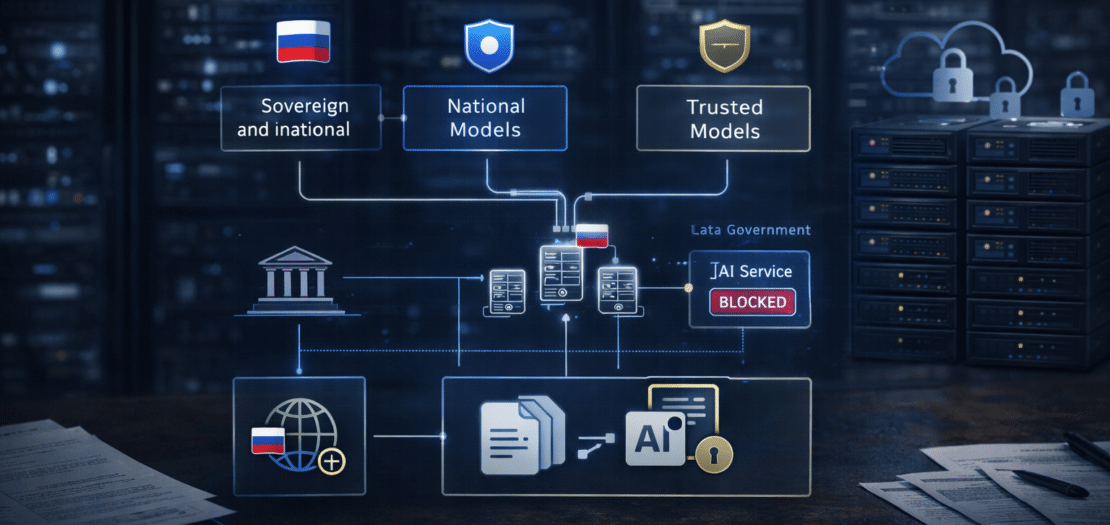

В проекте появляются сразу три важных категории. Суверенные модели, национальные модели и доверенные модели. И вот здесь уже лежит главный смысл будущих ограничений.

Суверенные и национальные модели в проекте описаны очень жестко. Все стадии разработки и обучения должны идти в России, этим должны заниматься российские граждане и российские юрлица, а данные для обучения тоже должны формироваться в России. Иначе говоря, это не просто «моделью пользуются в России», а модель по происхождению и контролю должна быть своей. Такой подход довольно прозрачно показывает, куда смотрит регулятор.

Где иностранному ИИ будет тесно в первую очередь

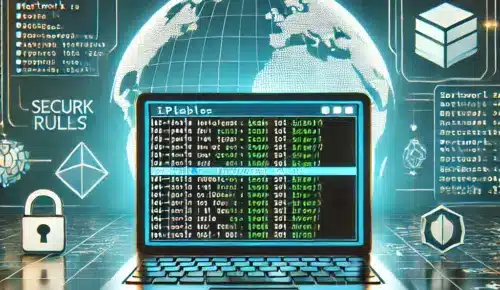

Самая чувствительная зона это не обычные пользователи, а государственные информационные системы и значимые объекты критической информационной инфраструктуры. В проекте прописана идея доверенных моделей. Именно такие модели хотят допускать к использованию в госсистемах и на значимых объектах КИИ.

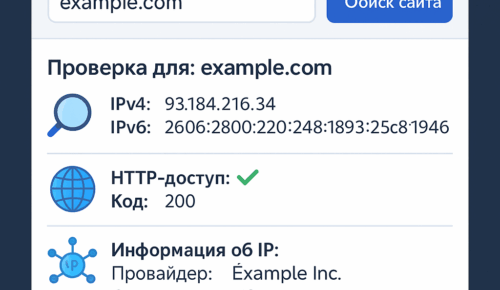

Чтобы стать доверенной, модели мало просто быть «умной» или популярной. Она должна пройти подтверждение по безопасности, обеспечивать обработку данных на территории России и соответствовать требованиям качества в нужной отрасли. Дальше такие модели попадут в специальный реестр, а правительство сможет установить случаи, когда использовать надо именно их.

Вот здесь уже начинается реальная развилка. На бумаге это пока не звучит как общий запрет иностранного ИИ для всех. Но для государства, КИИ, части банковского, транспортного, энергетического, медицинского и телеком контура в будущем это вполне может означать фактическое выдавливание зарубежных моделей из чувствительных процессов.

То есть иностранный ИИ все же не запретят совсем?

В текущем проекте, нет, не совсем так. И это принципиально важно. Дмитрий Григоренко прямо говорил, что для коммерческого сектора обязательные требования по использованию ИИ не устанавливаются. Это значит, что сейчас законопроект не выглядит как команда «всем срочно отключить иностранные нейросети».

Но успокаиваться раньше времени тоже не стоит. В проекте есть понятие трансграничных технологий искусственного интеллекта. И там прямо сказано, что их функционирование может быть запрещено или ограничено в случаях, установленных российским законодательством. Формулировка широкая. Очень широкая. Сегодня это рамка, завтра к ней могут докрутить уже конкретные правила.

То есть правильнее говорить так. Прямого общего запрета для всех в тексте пока нет. Но юридическая дорожка под будущие ограничения уже прокладывается, причем довольно старательно.

Почему разговоры о запрете появились не на пустом месте

Потому что это не первый заход на тему. Еще в феврале РБК писал о более жесткой инициативе, где прямо предлагалось запретить использовать в госсекторе ИИ, права на который принадлежат иностранным лицам. Там же звучал тезис о рисках утечки чувствительной информации в иностранные разведки и компании из недружественных юрисдикций.

Та февральская история выглядела прямолинейнее. Текущий проект написан аккуратнее и шире. Но если смотреть по вектору, логика очень похожая. Не хлопнуть дверью сразу, а построить такой режим, в котором государственная система сама вытолкнет иностранный ИИ из критически важных зон.

Ссылка на тот материал РБК тоже полезна для контекста: Ассоциация юристов предложила запретить иностранный ИИ в госсекторе.

Что меняется для обычных пользователей и бизнеса

Если вы обычный пользователь, завтра у вас, скорее всего, ничего не сломается. По крайней мере из этого проекта такой вывод не следует. Но в долгую могут измениться правила доступа, условия хранения данных, режим работы крупных сервисов и степень их совместимости с российским регулированием.

Если вы бизнес, особенно если вы внедряете ИИ в процессы, продаете сервис, используете нейросети в продукте или автоматизируете поддержку, маркетинг, аналитику, документооборот, тут уже надо смотреть внимательнее. Законопроект вводит обязанности для разработчиков, операторов и владельцев ИИ сервисов. Там есть требования по безопасности, тестированию, информированию пользователей, ограничениям на противоправный контент и механизмам, которые должны не допускать незаконное использование сервиса.

Отдельно примечательно правило для крупных ИИ сервисов. Если к сервису за сутки обращается больше 500 тысяч пользователей из России, проект привязывает владельца к дополнительным обязанностям по закону «Об информации». Проще говоря, чем больше аудитория, тем выше шанс, что государство захочет видеть не просто красивый интерфейс и быстрые ответы, а вполне конкретную управляемость сервиса.

Что будет с ИИ контентом

Еще одна важная часть проекта это маркировка синтезированного контента. Фото, видео, аудио и другой сгенерированный материал в логике проекта должны получать предупреждение о том, что это создано с применением ИИ. Причем не только в форме, понятной человеку, но и в машиночитаемом виде.

Для платформ это тоже не косметика. Крупные площадки должны будут проверять наличие такой маркировки и при ее отсутствии либо добавлять предупреждение, либо удалять материал. Если эта часть дойдет до реального и жесткого применения, креаторам, редакциям, бизнесу и просто тем, кто генерирует контент пачками, придется перестраивать процессы. Эпоха «сделал картинку и никто ничего не заметит» станет менее расслабленной.

Что хорошего в проекте тоже есть

Чтобы не скатиться в чистую апокалиптику, надо сказать честно, в проекте есть и нормальные вещи. Он дает гражданину право знать, когда в отношении него принимается автономное решение с использованием ИИ, затрагивающее его права и интересы. Там же есть идея о возможности досудебного обжалования решений, принятых с применением ИИ, и право на компенсацию вреда при неправомерном использовании таких технологий.

Это уже похоже на попытку хоть как то поставить алгоритмы в юридическую рамку, а не просто развесить лозунги про инновации. Другое дело, как все это потом будет работать на практике. Потому что между красивой нормой в тексте и живой бюрократической реальностью у нас обычно пролегает не дорожка, а целый пересеченный рельеф.

Чего ждать дальше

Сам законопроект сейчас не выглядит финальной и высеченной в камне версией. Это публичное обсуждение, и до сентября 2027 года еще много времени. Но направление уже видно.

Первое, государственный сектор и критическая инфраструктура будут все сильнее замыкать на российские и доверенные модели.

Второе, крупным иностранным ИИ сервисам будет все сложнее работать в России без адаптации под местные правила. Не обязательно через прямой запрет. Часто это делается намного тоньше, через требования к данным, безопасности, хранению, маркировке и юридическому присутствию.

Третье, бизнесу придется разбираться, какие ИИ инструменты у него вообще используются, где уходят данные, что хранится за рубежом, кто владелец модели, есть ли риск утечки и как это все будет выглядеть в глазах будущего регулирования.

Четвертое, интерес к open source моделям и self hosted сценариям внутри российских серверов, дата центров и корпоративных контуров будет только расти. Не потому что это модно, а потому что это становится управляемее и юридически спокойнее.

Мой вывод

Сейчас неправильно говорить, что в России уже приняли закон о полном запрете иностранного ИИ. Этого нет. Но так же неправильно делать вид, что ничего серьезного не происходит. Происходит.

Новый проект строит правовую архитектуру, в которой у государства появляются инструменты для поддержки своих моделей, допуска к чувствительным системам только доверенных решений, контроля за ИИ контентом и потенциального ограничения трансграничных ИИ технологий. То есть не рубильник «выключить все иностранное прямо сейчас», а аккуратная рамка, из которой через пару лет может вырасти уже вполне жесткий режим для отдельных отраслей и сценариев.

Для обычного пользователя это пока не конец света. Для госструктур, КИИ, крупных сервисов и бизнеса, который глубоко встраивает ИИ в процессы, это уже сигнал. И довольно громкий. Кто сейчас не ведет учет своих ИИ инструментов, не понимает, куда уходят данные и на чем держится его автоматизация, тот позже может очень неприятно удивиться.

Если вам нужен разбор, какие ИИ сервисы и сценарии у бизнеса или сайта сейчас уже попадают в зону будущих рисков, и как это лучше перестроить без лишней паники, связаться со мной можно через страницу контактов.